NGINX é um servidor web de alto desempenho amplamente utilizado em todo o mundo por sua velocidade, estabilidade e eficiência no uso de recursos. Criado para lidar com grandes volumes de acessos simultâneos, ele se tornou essencial em sites e aplicações que exigem alta disponibilidade e resposta rápida.

Além de servidor HTTP, o NGINX também funciona como proxy reverso, balanceador de carga, cache de conteúdo e proxy de aplicativos, oferecendo múltiplas funções em uma única solução. Sua arquitetura baseada em eventos permite atender milhares de conexões de forma leve e escalável, sendo ideal tanto para projetos simples quanto para infraestruturas complexas.

Essa combinação de flexibilidade, segurança e desempenho faz do NGINX uma das tecnologias mais adotadas em servidores modernos, sustentando grande parte do tráfego global da internet.

- O que é NGINX e sua arquitetura de eventos

- Instalação do NGINX em servidores Linux e Windows

- Configuração básica: nginx.conf e diretivas essenciais

- Otimizações de desempenho e ajustes avançados

- Segurança e boas práticas para proteção

- NGINX no contexto de containers e microsserviços

- Cache, compressão e entrega de conteúdo estático

- Uso como proxy reverso e balanceador de carga

- Monitoramento, logs e solução de problemas

- Perguntas frequentes sobre o NGINX

O que é NGINX e sua arquitetura de eventos

A arquitetura do NGINX é o que realmente diferencia essa tecnologia de outros servidores web. Seu design orientado a eventos permite que o sistema gerencie milhares de conexões simultâneas com eficiência e sem consumir recursos de forma excessiva. Em vez de criar um processo ou thread para cada nova requisição, o NGINX utiliza um modelo não bloqueante, no qual cada processo de trabalho (worker) pode atender múltiplas conexões ao mesmo tempo.

Esse formato foi criado para solucionar o chamado problema C10k, que representava o desafio de atender dez mil conexões simultâneas de forma estável e rápida. Enquanto servidores tradicionais enfrentavam limitações de hardware e sobrecarga de processos, o NGINX adotou uma arquitetura leve e modular, focada em eventos e filas assíncronas, possibilitando o uso eficiente de cada núcleo da CPU. Essa abordagem inovadora tornou o NGINX referência em performance e escalabilidade em ambientes de alta demanda.

Estrutura de processos:

Após a inicialização, o processo mestre é responsável por interpretar o arquivo de configuração principal (nginx.conf), iniciar os processos de trabalho e supervisionar seu funcionamento. Ele não participa diretamente do tratamento das requisições; sua função é atuar como um coordenador, garantindo que cada alteração de configuração ou atualização de versão ocorra sem a necessidade de reiniciar o servidor por completo. Isso possibilita o chamado reload gracioso, no qual o NGINX aplica mudanças em tempo real sem interromper as conexões ativas.

Os processos workers são os que efetivamente processam as requisições HTTP, HTTPS, e até TCP/UDP, dependendo do tipo de configuração. Cada worker executa um loop de eventos independente e é capaz de lidar com milhares de conexões simultâneas. O número de workers costuma ser ajustado de acordo com a quantidade de núcleos disponíveis no servidor, maximizando o aproveitamento de hardware. Como os workers não compartilham memória entre si, cada um opera de maneira isolada, o que aumenta a estabilidade e reduz o impacto de falhas individuais.

Já os processos auxiliares, menos conhecidos, executam tarefas específicas que otimizam o desempenho geral. Entre eles estão o processo de cache loader, responsável por carregar os dados de cache armazenados em disco quando o servidor é iniciado, e o cache manager, que atua na remoção periódica de itens expirados. Em ambientes com uso intensivo de cache, esses processos contribuem significativamente para reduzir a latência e evitar a sobrecarga de recursos.

| Tipo de processo | Função principal | Observações |

|---|---|---|

| Mestre | Inicia, gerencia e finaliza os processos de trabalho | Responsável por carregar as configurações e monitorar o funcionamento dos workers |

| Workers | Lidam diretamente com as requisições dos usuários | Cada worker executa um loop de eventos que processa várias conexões simultaneamente |

| Auxiliares | Cuidam de tarefas específicas, como gerenciamento de cache | Atuam em segundo plano, otimizando a performance e liberando recursos |

Essa separação de responsabilidades entre processos é uma das razões pelas quais o NGINX consegue manter alto desempenho e estabilidade, mesmo em cenários complexos. O isolamento entre o processo mestre e os workers também reforça a segurança, já que falhas no processamento de uma requisição não comprometem o controle global do servidor. Além disso, a arquitetura modular permite adicionar, remover ou atualizar componentes com mínima interferência no funcionamento geral, tornando o NGINX uma solução extremamente adaptável a diferentes tipos de aplicações.

Funcionamento do loop de eventos

O loop de eventos é o núcleo da operação do NGINX. Ele funciona como um ciclo contínuo que monitora todas as conexões abertas, identificando quando há algo novo a ser processado, como dados chegando de um cliente, uma resposta pronta para envio ou uma conexão que precisa ser encerrada. Cada worker mantém sua própria fila de eventos, e o sistema operacional notifica o NGINX sempre que ocorre uma mudança em qualquer uma dessas conexões.

Diferente de servidores baseados em threads, o NGINX não cria um novo processo para cada solicitação. Em vez disso, ele registra “interesses” em eventos, como leitura ou escrita, e executa pequenas tarefas à medida que os eventos acontecem. Essa estratégia assíncrona reduz drasticamente o consumo de CPU e memória, pois um único worker consegue processar milhares de requisições sem precisar multiplicar processos.

O NGINX utiliza chamadas do sistema operacional como epoll no Linux, kqueue no BSD e event ports no Solaris para detectar eventos de entrada e saída com altíssimo desempenho. Esses mecanismos são extremamente eficientes, pois trabalham diretamente no nível do kernel, permitindo ao NGINX responder rapidamente a novos pacotes de rede ou atualizações de conexão.

Durante o ciclo, o loop segue uma lógica bem definida:

- O worker aguarda notificações de novos eventos.

- Quando um evento é disparado (por exemplo, chegada de uma requisição HTTP), o worker o adiciona a uma fila interna.

- O NGINX processa o evento aplicando as regras configuradas (como redirecionamentos, proxy, cache ou compressão).

- Após o envio da resposta, o evento é encerrado e o worker retorna ao estado de espera.

Esse processo é executado milhares de vezes por segundo, de forma ininterrupta e sem desperdício de recursos. O resultado é uma latência muito baixa, mesmo em ambientes de alto tráfego.

Outro aspecto importante é a forma como o loop lida com conexões persistentes (keep-alive). Em vez de fechar a conexão após cada resposta, o NGINX pode mantê-la aberta para reutilização, reduzindo o tempo de estabelecimento de novas sessões. Isso melhora significativamente a experiência do usuário, principalmente em aplicações que realizam várias requisições seguidas.

Além disso, o loop de eventos permite ao NGINX operar de forma previsível sob carga pesada. Mesmo quando o número de conexões ativas aumenta exponencialmente, o consumo de memória cresce de forma linear e controlada. Essa eficiência explica por que o NGINX é amplamente usado em proxies reversos, balanceadores de carga e gateways de API, onde a capacidade de lidar com grandes quantidades de tráfego simultâneo é essencial.

Benefícios do modelo orientado a eventos

- Alta escalabilidade: o NGINX pode lidar com picos de acesso sem degradação perceptível.

- Menor consumo de CPU e RAM: ideal para ambientes com recursos limitados.

- Estabilidade contínua: a arquitetura previne travamentos e mantém o desempenho sob carga intensa.

- Gerenciamento eficiente de conexões persistentes: útil para aplicações modernas que exigem comunicação constante, como APIs e streams.

Essa combinação de desempenho e leveza é o que faz o NGINX ser amplamente escolhido por administradores de sistemas e desenvolvedores que precisam de uma base sólida para hospedar sites e aplicações de qualquer escala.

Instalação do NGINX em Linux e Windows

Antes de utilizar todo o potencial do NGINX, é fundamental garantir que ele esteja corretamente instalado no sistema operacional. A instalação adequada não apenas assegura que o servidor funcione de forma estável, mas também permite que todas as funcionalidades, como proxy reverso, balanceamento de carga, cache e streaming sejam utilizadas sem problemas. Um NGINX mal configurado ou instalado incorretamente pode gerar instabilidade, falhas em produção e dificuldades de manutenção.

Outro ponto importante é a compatibilidade com diferentes sistemas operacionais. Enquanto o NGINX é mais eficiente em Linux, devido à sua arquitetura otimizada para servidores baseados em Unix, ele também pode ser instalado no Windows para testes e desenvolvimento. Compreender as diferenças de instalação entre essas plataformas ajuda a evitar erros e a garantir que o servidor esteja preparado para o ambiente em que será executado.

O NGINX é compatível com múltiplos sistemas operacionais, sendo mais utilizado em distribuições Linux, mas também podendo ser instalado no Windows para fins de teste ou desenvolvimento. A instalação correta garante que o servidor funcione de maneira estável e que todas as funcionalidades, como proxy reverso, balanceamento de carga e cache, estejam disponíveis.

Instalação em Linux

A instalação do NGINX em Linux varia conforme a distribuição, mas os pacotes oficiais disponibilizados pelos repositórios garantem simplicidade e atualizações seguras. Abaixo seguem os principais passos para Ubuntu/Debian e CentOS/RHEL:

Ubuntu / Debian

# Atualizar repositórios

sudo apt update

sudo apt upgrade -y

# Instalar NGINX

sudo apt install nginx -y

# Iniciar o serviço

sudo systemctl start nginx

# Habilitar inicialização automática

sudo systemctl enable nginx

# Verificar status

sudo systemctl status nginxCentOS / RHEL

# Adicionar repositório EPEL

sudo yum install epel-release -y

# Instalar NGINX

sudo yum install nginx -y

# Iniciar o serviço

sudo systemctl start nginx

# Habilitar inicialização automática

sudo systemctl enable nginx

# Verificar status

sudo systemctl status nginx

Após a instalação, o NGINX estará acessível pelo navegador através do IP do servidor na porta 80. Para testar, basta digitar http://seu_ip/ e verificar se a página padrão do NGINX aparece.

Instalação em Windows

No Windows, o NGINX não é destinado a produção, mas pode ser utilizado para testes, desenvolvimento ou aprendizado. A instalação é mais simples, pois não depende de gerenciadores de pacotes.

- Download do NGINX

- Acesse o site oficial: nginx.org/en/download.html

- Baixe a versão stable para Windows.

- Descompactar o arquivo

- Extraia o conteúdo do

.zipem uma pasta, por exemplo:C:\nginx.

- Extraia o conteúdo do

- Executar o NGINX

- Abra o Prompt de Comando, navegue até a pasta

C:\nginxe execute:

- Abra o Prompt de Comando, navegue até a pasta

start nginx

- Parar o servidor

nginx -s stop

- Testar a instalação

- Abra um navegador e digite

http://localhost/. A página padrão do NGINX deve ser exibida.

- Abra um navegador e digite

Observação: No Windows, o NGINX não possui suporte completo a algumas funcionalidades avançadas de produção, como otimizações de E/S e integração com módulos de segurança específicos.

Configuração inicial pós instalação

Após a instalação, é recomendável:

- Verificar a porta padrão (80 para HTTP e 443 para HTTPS) e alterar se necessário.

- Ajustar o arquivo

nginx.confpara definirworker_processeseworker_connections, otimizando o desempenho conforme o hardware disponível. - Configurar firewall para liberar portas necessárias, permitindo o acesso externo de clientes.

- Testar o acesso via navegador ou comandos

curlpara garantir que o NGINX está respondendo corretamente.

Boas práticas após a instalação

Para garantir estabilidade, segurança e desempenho do NGINX, é essencial seguir algumas práticas recomendadas desde a instalação:

- Utilize repositórios oficiais e versões estáveis

Sempre instale o NGINX a partir dos repositórios oficiais ou do site oficial. Isso assegura que você receba atualizações de segurança e correções de bugs sem comprometer a estabilidade do servidor. - Configure corretamente os workers e conexões

Ajuste os parâmetrosworker_processeseworker_connectionsnonginx.confde acordo com a quantidade de núcleos da CPU e o volume esperado de tráfego. Isso evita sobrecarga dos processos e melhora a performance em picos de acesso. - Ative logs e monitore o servidor

Mantenha os logs de acesso (access.log) e de erro (error.log) ativos. Ferramentas de análise de logs ajudam a identificar problemas, monitorar padrões de tráfego e detectar tentativas de ataques ou falhas de configuração. - Teste sempre as alterações de configuração

Antes de aplicar mudanças no NGINX, execute:sudo nginx -tEsse comando verifica se a sintaxe do arquivonginx.confestá correta. Em seguida, utilize:sudo systemctl reload nginxpara aplicar as alterações sem interromper o serviço. - Gerencie portas e firewall

Certifique-se de que as portas usadas pelo NGINX (como 80 para HTTP e 443 para HTTPS) estejam liberadas no firewall e em roteadores, garantindo acesso seguro e consistente aos clientes. - Use containers ou máquinas virtuais para testes

Especialmente em Windows ou ambientes de desenvolvimento, utilize containers Docker ou máquinas virtuais Linux para reproduzir a configuração de produção. Isso ajuda a evitar conflitos e facilita a replicação de ambientes. - Implemente certificados e HTTPS desde o início

Mesmo em ambientes de teste, é recomendado configurar SSL/TLS. Isso facilita a migração para produção e garante familiaridade com a configuração de certificados digitais, além de permitir testes seguros de aplicações que exigem HTTPS. - Mantenha o NGINX atualizado

Monitore regularmente novas versões estáveis e patches de segurança. Atualizações frequentes garantem correções de vulnerabilidades e melhorias de desempenho, reduzindo riscos de falhas ou ataques.

Configuração: nginx.conf e diretivas essenciais

O arquivo nginx.conf é o coração da configuração do NGINX. Ele define como o servidor irá processar requisições, gerenciar conexões, aplicar regras de cache, controlar logs, habilitar SSL/TLS e muito mais. Uma configuração básica bem estruturada garante que o servidor funcione de forma eficiente, segura e escalável.

O NGINX utiliza uma sintaxe baseada em blocos e diretivas, em que cada diretiva possui parâmetros específicos. O arquivo principal geralmente é dividido em blocos principais, como events, http, server e location. Esses blocos determinam o comportamento global do servidor e suas aplicações para diferentes domínios e endpoints.

Estrutura do arquivo nginx.conf

Um exemplo simplificado de nginx.conf:

user www-data;

worker_processes auto;

pid /run/nginx.pid;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

sendfile on;

keepalive_timeout 65;

server {

listen 80;

server_name localhost;

location / {

root /var/www/html;

index index.html index.htm;

}

error_page 404 /404.html;

}

}| Bloco / Diretiva | Função | Observações |

|---|---|---|

| user | Define o usuário do sistema que executa os processos worker | Geralmente www-data em Linux |

| worker_processes | Número de processos worker | Pode ser auto para usar todos os núcleos da CPU |

| events | Configurações do loop de eventos | Contém worker_connections e outros parâmetros de desempenho |

| http | Bloco principal para HTTP | Contém servidores, caches, compressão e cabeçalhos |

| server | Configurações de um host virtual | Define portas, domínios, logs, SSL e regras de localização |

| location | Define o tratamento de URLs específicas | Pode aplicar redirecionamentos, regras de cache ou proxies |

| error_page | Define páginas de erro personalizadas | Pode redirecionar códigos HTTP para arquivos HTML ou rotas específicas |

Diretivas essenciais de performance

- worker_connections: define quantas conexões simultâneas cada worker pode atender. Exemplo:

worker_connections 2048;

- keepalive_timeout: controla o tempo de manutenção de conexões persistentes. Exemplo:

keepalive_timeout 65;

- sendfile: habilita envio eficiente de arquivos estáticos diretamente do kernel. Exemplo:

sendfile on;

- gzip: ativa compressão de respostas HTTP, reduzindo consumo de banda:

gzip on;

gzip_types text/plain text/css application/javascript;

Exemplo de múltiplos servidores

http {

server {

listen 80;

server_name site1.com;

location / {

root /var/www/site1;

}

}

server {

listen 80;

server_name site2.com;

location / {

root /var/www/site2;

}

}

}

Esse exemplo permite que o NGINX sirva múltiplos sites no mesmo servidor, cada um com sua raiz (root) e regras específicas.

Dicas de configuração

- Sempre teste alterações com:

sudo nginx -t

- Use

includepara separar configurações de sites ou módulos em arquivos distintos, mantendo onginx.conforganizado. - Defina logs separados para cada servidor usando

access_logeerror_logpersonalizados. - Para ambientes de alta performance, ajuste

worker_processeseworker_connectionsconforme CPU e memória disponíveis.

Otimizações de desempenho e ajustes avançados

O NGINX é amplamente reconhecido pela sua leveza e eficiência, mas o verdadeiro poder dessa tecnologia surge quando suas configurações são ajustadas para o cenário específico do servidor. Pequenos ajustes em parâmetros como número de processos, cache e compressão podem representar diferenças significativas em performance especialmente em aplicações de alta escala ou com alto volume de requisições simultâneas.

1. Ajustes de processos e conexões

A base da performance do NGINX está em sua arquitetura orientada a eventos e processos leves chamados workers.

Cada worker process é responsável por lidar com milhares de conexões simultaneamente, de forma não bloqueante.

Definir corretamente os valores de worker_processes e worker_connections é essencial para aproveitar toda a capacidade do hardware.

worker_processes auto;

worker_connections 4096;O valor auto faz com que o NGINX detecte automaticamente o número de núcleos do processador e ajuste a quantidade ideal de processos de trabalho.

Já worker_connections define quantas conexões simultâneas cada worker pode manter abertas. Multiplicando os dois valores, você obtém a capacidade teórica total do servidor.

Em ambientes de alto tráfego, também é recomendado ajustar:

use epoll;

multi_accept on;Essas diretivas instruem o NGINX a aceitar várias conexões em um único ciclo de evento, reduzindo a latência e melhorando a resposta sob cargas pesadas.

Observação técnica:

Em servidores Linux modernos, o uso de epoll é fundamental. Ele substitui o método de I/O padrão por um sistema baseado em eventos, otimizando a escalabilidade para dezenas de milhares de conexões simultâneas uma das principais razões pelas quais o NGINX é preferido em plataformas de streaming, SaaS e e-commerces de alto volume.

2. Reutilização de conexões e buffers otimizados

O tempo de resposta de uma aplicação depende muito da forma como o NGINX gerencia as conexões TCP e o envio de dados.

Ativar o keep-alive permite que múltiplas requisições usem a mesma conexão persistente, reduzindo o custo de abertura e fechamento de sockets.

keepalive_timeout 75s;

sendfile on;

tcp_nopush on;

tcp_nodelay on;Essas diretivas melhoram o fluxo de pacotes e evitam fragmentação durante o envio de grandes arquivos.

O sendfile instrui o NGINX a ler arquivos diretamente do sistema de arquivos para o socket de rede, sem cópias intermediárias na memória do usuário uma otimização que reduz o uso de CPU em até 30% em servidores de conteúdo estático.

O uso de tcp_nopush e tcp_nodelay equilibra a eficiência da rede, permitindo que os pacotes sejam agrupados de forma inteligente, o que é especialmente útil em conexões com latência mais alta.

Cenário prático:

Em um servidor de vídeos ou imagens, onde o volume de dados transmitidos é alto, essas configurações reduzem a latência média e aumentam a taxa de transferência, garantindo respostas mais rápidas e consistentes.

3. Caching estratégico

O cache é uma das formas mais eficazes de reduzir o tempo de resposta e aliviar o servidor de aplicação.

Ao armazenar o resultado de respostas estáticas (como CSS, imagens e scripts), o NGINX evita que cada requisição precise ser processada novamente.

proxy_cache_path /var/cache/nginx levels=1:2 keys_zone=conteudo_estatico:20m inactive=24h max_size=2g;Essa configuração cria uma zona de cache chamada conteudo_estatico com limite de 2 GB.

O parâmetro inactive define o tempo máximo em que um item inativo é mantido no cache antes de ser descartado.

Além disso, a diretiva expires pode ser usada para instruir os navegadores a manter cópias locais:

location ~* \.(jpg|jpeg|png|css|js)$ {

expires 30d;

add_header Cache-Control "public, no-transform";

}Com esse ajuste, o navegador do usuário evita novos downloads desnecessários, reduzindo a carga de banda e acelerando a renderização de páginas.

Benefício direto:

O cache reduz drasticamente o tempo de resposta percebido pelo usuário final e libera recursos do backend, permitindo que ele se concentre em tarefas dinâmicas.

4. Compressão Gzip e Brotli

A compressão é uma das formas mais simples e eficazes de reduzir o uso de banda e o tempo de carregamento de páginas.

O NGINX oferece suporte nativo ao Gzip e pode ser expandido com módulos adicionais como o Brotli, desenvolvido pelo Google.

gzip on;

gzip_types text/plain application/json text/css application/javascript;

gzip_min_length 1024;

gzip_comp_level 5;Essas diretivas ativam a compactação de arquivos maiores que 1 KB e equilibram o nível de compressão e desempenho.

O Brotli, por sua vez, oferece taxas de compressão até 25% melhores que o Gzip e é ideal para sites com tráfego predominantemente HTTPS.

Dica técnica:

Evite comprimir arquivos já otimizados, como .zip ou .jpg, pois isso apenas consome CPU sem ganhos reais.

5. Limitação de requisições e controle de tráfego

Proteger o servidor contra excesso de requisições e ataques de negação de serviço é essencial.

O NGINX possui módulos nativos que controlam o volume de tráfego por IP, aplicando rate limiting e filas de espera inteligentes.

limit_req_zone $binary_remote_addr zone=req_limit:10m rate=10r/s;

limit_req zone=req_limit burst=20 nodelay;Com essa configuração, cada cliente pode fazer até 10 requisições por segundo, com tolerância a picos temporários (até 20 requisições extras sem atraso).

Importante:

Esse tipo de limitação é útil não apenas contra ataques, mas também para equilibrar o tráfego em aplicações públicas com APIs.

Evita que usuários individuais sobrecarreguem o sistema e mantém a estabilidade geral do ambiente.

6. Monitoramento e métricas de desempenho

Monitorar o comportamento do NGINX é indispensável para identificar gargalos.

Ferramentas como NGINX Amplify, Grafana, Prometheus e Zabbix são amplamente utilizadas para acompanhar métricas de conexões, latência, uso de CPU e resposta de upstreams.

No próprio NGINX, é possível definir logs detalhados:

log_format performance '$remote_addr $status $request_time $upstream_response_time';

access_log /var/log/nginx/performance.log performance;Esses logs permitem correlacionar o tempo de resposta do servidor e o tempo gasto no backend, facilitando a identificação de falhas em aplicações PHP, Node.js ou Python que operam por trás do proxy.

Boas práticas:

- Analise picos de tráfego com base nos logs de

request_time. - Monitore a quantidade de conexões keepalive e timeouts.

- Use gráficos históricos para prever quando será necessário escalar o ambiente.

7. Ajustes finos para alta escala

Em sistemas que processam milhões de requisições diárias, otimizações adicionais podem fazer grande diferença:

- Use SSDs para armazenar cache e logs, reduzindo o I/O.

- Ative HTTP/2, que permite múltiplas requisições simultâneas por conexão.

- Evite redirecionamentos e reescritas desnecessárias no

nginx.conf. - Ajuste os buffers (

client_body_buffer_size,client_max_body_size) conforme o tipo de aplicação. - Configure

aio on;para leitura assíncrona de arquivos grandes.

Essas práticas avançadas garantem que o NGINX opere no máximo de sua eficiência, mesmo em cenários de tráfego global e balanceamento entre múltiplos servidores.

Segurança e boas práticas para proteção

A segurança no NGINX vai muito além da simples configuração de certificados SSL. Ela envolve um conjunto de práticas que fortalecem o ambiente contra ataques cibernéticos, vazamento de dados e falhas de configuração que podem comprometer a integridade do sistema. Um servidor web, por natureza, está constantemente exposto à internet e qualquer descuido pode abrir brechas para invasões, exploração de vulnerabilidades e interrupções de serviço.

A primeira camada de defesa começa pela atualização constante do software. O NGINX é um projeto ativo, com correções e aprimoramentos frequentes. Manter a versão sempre atualizada garante a aplicação de patches de segurança essenciais. Além disso, é importante que o sistema operacional subjacente também esteja em dia, especialmente em distribuições Linux utilizadas em servidores de produção, como Ubuntu, Debian ou CentOS. Um servidor atualizado é um servidor menos vulnerável.

Outro ponto fundamental está na definição de permissões e isolamento de processos. O NGINX não deve ser executado com privilégios administrativos permanentes. O ideal é que ele opere sob um usuário específico e restrito, sem acesso desnecessário a diretórios sensíveis. Isso impede que, mesmo em caso de invasão, o atacante consiga escalar privilégios ou modificar arquivos críticos do sistema.

A proteção das requisições também deve ser tratada com cuidado. O uso de cabeçalhos HTTP seguros é essencial para evitar ataques de injeção, cross-site scripting e roubo de cookies. Cabeçalhos como X-Frame-Options, X-Content-Type-Options, Content-Security-Policy e Strict-Transport-Security funcionam como escudos invisíveis, impedindo que navegadores executem conteúdo malicioso injetado por terceiros. Em ambientes corporativos, a política de segurança deve incluir a verificação de cada um desses cabeçalhos antes da publicação de qualquer página.

O controle de acesso a diretórios e arquivos internos é outro ponto frequentemente negligenciado. Muitas vezes, logs, backups e scripts de teste ficam acessíveis por URLs previsíveis, representando um risco severo. O NGINX permite que esses diretórios sejam ocultados e negados a qualquer tentativa externa de acesso. Além disso, a estrutura do servidor deve ser organizada de modo a separar conteúdos públicos dos privados, impedindo que arquivos administrativos fiquem próximos aos que são servidos aos visitantes.

A criptografia de dados é indispensável. O uso de certificados digitais válidos, preferencialmente emitidos por autoridades reconhecidas, assegura a confidencialidade da comunicação entre cliente e servidor. Além do SSL/TLS tradicional, é importante manter a configuração dos protocolos atualizada, desativando versões antigas e vulneráveis, como SSLv3 e TLS 1.0. O suporte ao TLS 1.3 é altamente recomendado, pois oferece mais velocidade e segurança, com menos pontos de falha na negociação da conexão.

A autenticação também pode ser reforçada por meio de controle de acesso a rotas sensíveis. Recursos administrativos e APIs devem exigir autenticação segura, com senhas fortes, tokens temporários e, preferencialmente, autenticação em múltiplos fatores. Em servidores que hospedam múltiplos domínios, é recomendável aplicar isolamento por virtual hosts, de forma que falhas em um site não afetem os demais.

A observação constante dos logs do NGINX é outro pilar da segurança. Eles funcionam como uma trilha digital das atividades do servidor e permitem identificar padrões anormais, como tentativas repetidas de login, varreduras de portas ou picos de tráfego suspeitos. A integração desses logs com sistemas de monitoramento e alertas automatizados garante que qualquer anomalia seja detectada antes que cause danos.

A segurança também deve considerar o aspecto humano. Senhas fracas, compartilhamento de credenciais e permissões mal configuradas são causas recorrentes de incidentes. Políticas internas de segurança, revisões periódicas e a educação contínua da equipe técnica são medidas tão importantes quanto a própria configuração do servidor.

Por fim, a melhor prática de segurança é a prevenção. O NGINX, quando configurado de maneira consciente, se torna uma camada robusta de proteção que trabalha silenciosamente em segundo plano. O equilíbrio entre desempenho, proteção e simplicidade deve sempre guiar as decisões de configuração, garantindo não apenas a estabilidade, mas a confiança de que o servidor resistirá a ataques e continuará entregando conteúdo de forma segura e eficiente.

NGINX no contexto de containers e microsserviços

A transformação das arquiteturas monolíticas para ambientes distribuídos impulsionou a necessidade de componentes capazes de lidar com tráfego intenso, rotas complexas e serviços altamente dinâmicos. Nesse cenário, o NGINX assumiu um papel estratégico como intermediário entre aplicações containerizadas e como elemento-chave de comunicação em ecossistemas de microsserviços. Sua leveza, previsibilidade e capacidade de operar sob altas cargas fazem com que ele seja um dos componentes mais utilizados em plataformas de orquestração modernas.

Nos containers, sua função vai além de servir como um simples servidor web. Ele atua como ponto de entrada, provedor de políticas de acesso, controlador de tráfego interno e, frequentemente, como camada de segurança que envolve e protege serviços distribuídos. Além disso, seu desempenho consistente permite que equipes mantenham ambientes ágeis sem abrir mão de estabilidade, algo essencial em ciclos curtos de deploy.

NGINX e containers: um operador fundamental

A adoção de containers trouxe a necessidade de componentes que pudessem ser executados de forma igualmente modular. O NGINX se encaixa perfeitamente nesse modelo, pois pode rodar como um container independente, separado da aplicação e configurado para manipular todo o tráfego da stack. Isso facilita atualizações, rollback, mapeamento de portas, versionamento e padronização entre ambientes.

Quando utilizado em plataformas como Docker Compose, ele frequentemente concentra funções como roteamento, tratamento de sessões, compressão e controle de cache, enquanto containers individuais cuidam apenas da lógica de negócio. Essa separação de responsabilidades deixa o ambiente mais organizado e diminui o acoplamento entre componentes, algo essencial em arquiteturas que evoluem continuamente.

Microsserviços e o papel do NGINX como coordenador de tráfego

Em arquiteturas de microsserviços, cada função da aplicação está dividida em partes pequenas, independentes e comunicáveis entre si. O NGINX opera como uma espécie de “ponte inteligente”, gerenciando fluxos que podem mudar rapidamente conforme novas versões são lançadas, serviços são escalados ou instâncias são reiniciadas.

Essa adaptabilidade torna possível:

- direcionar requisições com base em regras detalhadas;

- identificar automaticamente instâncias ativas e inativas;

- distribuir carga entre múltiplos serviços que executam a mesma função;

- manter a consistência do tráfego mesmo quando componentes sobem e caem durante o processo de deploy.

Em outras palavras, ele mantém a fluidez e estabilidade da comunicação em um ambiente que, por natureza, é volátil.

NGINX como Ingress Controller em Kubernetes

Quando transportado para orquestradores como Kubernetes, o NGINX ganha funções mais sofisticadas. Como Ingress Controller, ele interpreta configurações declaradas no cluster e transforma essas instruções em regras práticas de roteamento. Isso inclui controle de TLS, limitação de taxa, segmentação de rotas, redirecionamentos, políticas de acesso e suporte a múltiplos hosts.

Além disso, sua capacidade de manipulação de tráfego em nível granular permite que equipes implementem estratégias modernas como blue/green deployment, canary release e segmentação por headers, mantendo a operação contínua enquanto testes e atualizações são realizados.

Monitoramento, telemetria e visibilidade operacional

A previsibilidade do fluxo de requisições é crucial em ambientes distribuídos. O NGINX facilita esse processo ao expor métricas essenciais para monitoramento e análise de desempenho. Ferramentas como Prometheus, Grafana e ELK interpretam esses dados e entregam visibilidade sobre latência, volume de tráfego, taxa de erros e comportamento dos endpoints.

Com isso, equipes conseguem agir preventivamente, ajustar políticas de controle, redefinir limites e diagnosticar problemas que surgem somente em alta escala. O NGINX se torna não apenas um roteador de tráfego, mas também uma fonte valiosa de inteligência operacional.

Uma peça indispensável na arquitetura moderna

A combinação de flexibilidade, eficiência e estabilidade coloca o NGINX como elemento central em ambientes nativos em nuvem. Seu papel não se limita a abrir conexões, mas a manter o áudio perfeito entre serviços que precisam funcionar de forma coordenada, escalável e segura. Em estruturas baseadas em containers e microsserviços, ele se torna uma camada de organização, controle e otimização essencial para a longevidade e o crescimento saudável de qualquer aplicação moderna.

Cache, compressão e entrega de conteúdo estático

Quando falamos em desempenho real de um site, especialmente em projetos com alto volume de acesso, o problema raramente está apenas no servidor. Na maioria das vezes, ele está na forma como os recursos estáticos são entregues ao navegador. E é exatamente aqui que cache, compressão e otimização de conteúdo fazem toda a diferença.

O NGINX atua como um distribuidor inteligente desses recursos. Em vez de fazer com que cada imagem, CSS ou JavaScript seja buscado novamente a cada acesso, ele permite que esses arquivos fiquem armazenados em cache tanto no navegador do usuário quanto no próprio servidor. Isso reduz drasticamente o número de requisições repetidas, diminui o consumo de banda e melhora a experiência do visitante, principalmente em conexões mais lentas.

Outro ponto fundamental é a compressão. Ao compactar os arquivos antes de enviá-los ao cliente, o NGINX consegue reduzir significativamente o tamanho dos dados transferidos. Isso se traduz em carregamentos mais rápidos, menor uso de dados móveis e melhor desempenho em dispositivos mais simples. Em ambientes modernos, essa otimização impacta diretamente métricas como Core Web Vitals e tempo de interação da página.

Já na entrega de conteúdo estático, o NGINX se destaca por sua eficiência em servir arquivos diretamente, sem a necessidade de passar por linguagens intermediárias como PHP ou Node.js. Isso torna o processo muito mais leve, previsível e escalável, especialmente em sites que possuem muitos assets visuais, como plataformas educacionais, e-commerces, blogs e sistemas web em geral.

Além disso, uma boa estratégia de cache permite que o servidor reduza sua carga de processamento em horários de pico, mantendo a estabilidade mesmo sob alto tráfego. Quando bem configurado, o NGINX consegue responder a milhares de requisições simultâneas com baixo consumo de recursos, o que representa um ganho direto tanto em desempenho quanto em economia de infraestrutura.

Outro aspecto importante é a integração com redes de distribuição de conteúdo (CDNs). O NGINX funciona perfeitamente em conjunto com essas redes, atuando como ponto de origem (origin server), enquanto o conteúdo estático é replicado geograficamente. Isso garante que usuários de diferentes regiões tenham tempos de resposta menores, melhorando a experiência global da aplicação.

Por fim, a forma como o conteúdo estático é organizado e servido também influencia diretamente na percepção de qualidade do site. Layouts que carregam mais rápido, imagens que aparecem de forma progressiva e scripts que não bloqueiam a renderização contribuem para uma navegação mais fluida, reduzindo taxas de rejeição e aumentando o tempo de permanência do usuário.

Uso como proxy reverso e balanceador de carga

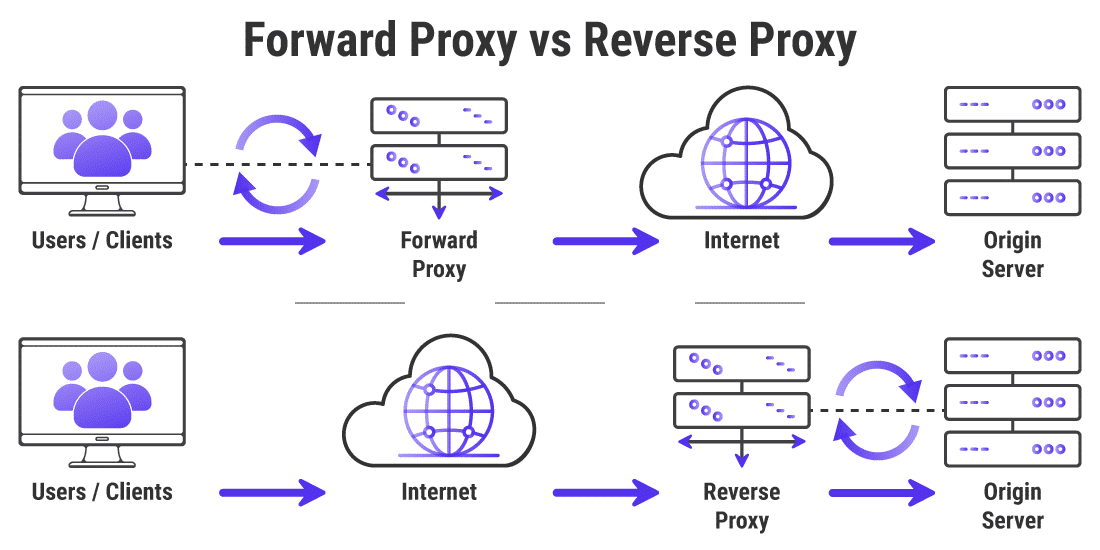

O NGINX é amplamente utilizado como camada intermediária entre usuários e servidores de aplicação. Nesse papel, ele não apenas distribui tráfego, mas protege, organiza e otimiza toda a comunicação entre o cliente e os serviços internos, sendo peça-chave em arquiteturas modernas.

Proxy reverso na prática

Quando o NGINX atua como proxy reverso, ele recebe todas as requisições externas e decide para onde cada uma deve ser encaminhada internamente. Isso permite ocultar a estrutura real de servidores da internet, trazendo mais segurança, controle e flexibilidade.

Em ambientes corporativos, essa função é essencial para distribuir requisições entre serviços diferentes, como APIs, aplicações web, painéis administrativos e microsserviços. O usuário nunca acessa diretamente esses serviços, ele se comunica apenas com o NGINX, que funciona como uma “porta de entrada inteligente”.

Além disso, essa abordagem facilita mudanças internas sem impactar o usuário final. Se um serviço for migrado de servidor, trocar de tecnologia ou mudar de endereço interno, tudo pode ser ajustado no NGINX sem afetar URLs públicas nem quebrar integrações existentes.

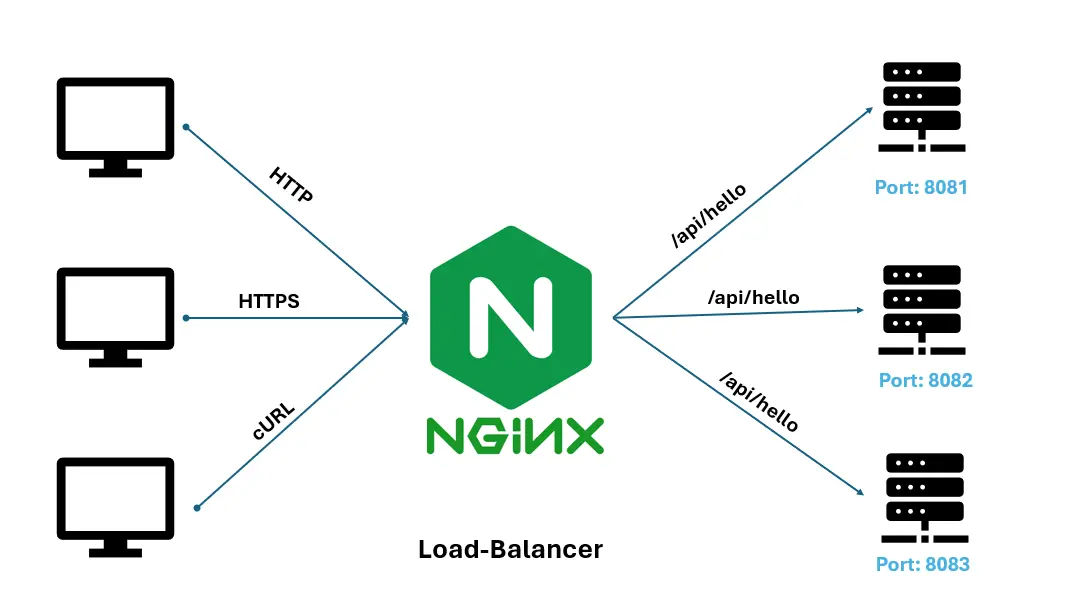

Arquitetura de balanceamento de carga

O balanceamento de carga é uma das aplicações mais estratégicas do NGINX, principalmente em ambientes com alto volume de acessos simultâneos. Ele distribui as conexões entre múltiplos servidores de back-end, evitando sobrecarga em um único ponto e garantindo maior disponibilidade do sistema.

Esse modelo é amplamente utilizado em sites de grande tráfego, sistemas financeiros, plataformas de streaming, marketplaces e sistemas corporativos. Ao distribuir as requisições, o NGINX melhora o tempo de resposta, reduz quedas por sobrecarga e aumenta a capacidade de escalabilidade horizontal.

Outro ponto importante é que, ao detectar que um servidor está indisponível ou respondendo com erro, o NGINX pode automaticamente redirecionar o tráfego para outros nós ativos, garantindo continuidade de serviço mesmo em cenários de falha.

Integração com microsserviços

Em arquiteturas baseadas em microsserviços, o NGINX assume um papel ainda mais relevante. Ele passa a funcionar como um gateway central, direcionando tráfego para dezenas ou até centenas de serviços independentes.

Cada serviço cuida de uma funcionalidade específica, mas para o usuário tudo parece uma única aplicação integrada. O NGINX é responsável por transformar essa complexidade interna em algo simples e transparente externamente.

Isso também permite aplicar políticas de acesso, limites de requisição, autenticação, controle de origem e roteamento inteligente, sem que cada microsserviço precise implementar essas funções individualmente.

Impacto direto na performance e estabilidade

Além da organização arquitetural, o uso de proxy reverso e balanceamento de carga impacta diretamente a performance percebida pelo usuário. A distribuição eficiente reduz latência, evita gargalos e melhora o tempo de carregamento em situações de pico.

Em sistemas bem estruturados, o visitante sequer percebe que por trás existe uma rede complexa de servidores e serviços. Tudo funciona de forma fluida porque o NGINX gerencia o tráfego de maneira transparente, estável e previsível.

Monitoramento, logs e solução de problemas

O monitoramento é uma das funções mais importantes dentro de qualquer ambiente web, especialmente quando o servidor ou proxy lida com grande volume de tráfego. No caso do Nginx, acompanhar métricas e analisar registros permite identificar gargalos, entender o comportamento dos usuários e agir rapidamente diante de falhas. Um sistema bem monitorado reduz indisponibilidades, melhora o desempenho e facilita tomadas de decisão estratégicas.

Os logs são a principal fonte de diagnóstico do Nginx. Eles registram tudo: requisições recebidas, status HTTP, tempo de resposta, erros internos, bloqueios, redirecionamentos e até detalhes sobre o cliente que realizou o acesso. Existem dois tipos principais: access_log (tráfego e comportamento) e error_log (falhas e exceções). Quando bem configurados, tornam-se ferramentas de alto valor para desenvolver melhorias, otimizar desempenho e antecipar problemas.

Solução de problemas no Nginx envolve uma combinação de boas práticas: leitura de logs, testes unitários de configuração, validações incrementais e acompanhamento de métricas externas. As causas mais comuns de falhas incluem permissões incorretas, configuração mal formatada, excesso de carga, upstream indisponível e bloqueios por firewall. A vantagem é que o Nginx fornece mensagens relativamente claras, e a maioria dos erros pode ser rapidamente isolada.

Principais pontos monitorados no dia a dia

| Área Monitorada | Descrição | Indicadores Importantes |

|---|---|---|

| Desempenho do Servidor | Avalia carga e resposta das operações internas | CPU, RAM, I/O, load average |

| Tráfego e Requisições | Observa volume e comportamento de usuários | Requisições/segundo, picos e quedas |

| Estabilidade do Upstream | Identifica falhas nos serviços de destino | Tempo de resposta, falhas 502/503 |

| Segurança | Aponta comportamentos suspeitos | Tentativas de ataque, acessos bloqueados |

| Integridade da Configuração | Verifica erros sintáticos e conflitos | nginx -t, duplicidade de diretivas |

Ferramentas que ampliam o monitoramento

Além dos logs internos, diversas soluções externas agregam visibilidade ao ambiente:

- Grafana + Prometheus

Coletam métricas de desempenho e exibem gráficos em tempo real. - ELK Stack (Elasticsearch, Logstash, Kibana)

Transforma logs brutos em dashboards detalhados. - Zabbix e Datadog

Monitoramento corporativo com alertas inteligentes. - GoAccess

Análise rápida de logs diretamente no terminal.

Essas ferramentas facilitam identificar tendências, anomalias, quedas de performance e comportamentos fora do padrão.

Erros mais comuns e como resolvê-los

- “502 Bad Gateway”

Geralmente causado por falha no serviço upstream. Verifique se o servidor backend está ativo e respondendo. - “504 Gateway Timeout”

O backend demorou a responder. Ajusteproxy_read_timeoutou otimize o serviço de destino. - “413 Request Entity Too Large”

Arquivo enviado maior que o permitido. Ajusteclient_max_body_size. - “Permission denied”

Diretórios ou arquivos com permissões incorretas. Corrija comchmodechown. - Configurações inválidas

Sempre valide comnginx -tantes de reiniciar.

Checklist rápido para solucionar problemas

- Validar a configuração (

nginx -t). - Consultar

error_logpara identificar o erro exato. - Verificar disponibilidade do upstream.

- Revisar permissões e caminhos utilizados.

- Testar novamente após ajustes.

- Monitorar métricas para confirmar estabilidade.

Por que tudo isso importa?

Monitoramento, análise de logs e práticas sólidas de solução de problemas não são apenas tarefas técnicas, são pilares estratégicos para qualquer ambiente que dependa de estabilidade e desempenho. Quando esses processos estão bem estruturados, a equipe ganha visibilidade imediata sobre a saúde do sistema e consegue agir antes que pequenos alertas se transformem em falhas críticas. Essa capacidade de antecipação é o que diferencia ambientes robustos de ambientes vulneráveis.

Outro ponto essencial é a confiabilidade percebida pelo usuário final. Quando o servidor responde rápido, mantém estabilidade durante picos de tráfego e não apresenta interrupções frequentes, a experiência melhora e a confiança no serviço aumenta. Em e-commerce, portais institucionais e aplicações SaaS, isso tem impacto direto em vendas, permanência do cliente e retenção. Um ambiente que cai com frequência custa caro, não apenas financeiramente, mas também em credibilidade.

Do lado operacional, logs organizados e monitoramento inteligente reduzem o tempo gasto na resolução de incidentes. Em vez de “procurar agulhas no palheiro”, os registros mostram exatamente onde ocorreu a falha, qual componente foi afetado e qual diretiva pode estar causando o problema. Isso diminui retrabalho, acelera correções e torna o time mais eficiente, especialmente em equipes enxutas.

Outro benefício pouco comentado é a segurança. Muitos ataques começam silenciosamente, com tentativas de força bruta, scanners automatizados, varreduras de diretório ou requisições anômalas. Sem monitoramento contínuo e sem logs acessíveis, essas atividades passam despercebidas e podem evoluir para vulnerabilidades exploradas. Com visibilidade adequada, é possível bloquear padrões suspeitos, ajustar regras de firewall, automatizar respostas e mitigar riscos.

Por fim, monitoramento e análise de logs permitem evoluir o ambiente de maneira consciente. Ao entender picos de demanda, horários de maior acesso, comportamento dos usuários e gargalos do back-end, torna-se possível planejar expansões, configurar cache de maneira mais eficiente, distribuir cargas entre servidores e otimizar recursos. Isso significa um ambiente mais rápido, escalável e econômico, tudo baseado em dados reais, e não em suposições.

Em resumo: monitorar, registrar e resolver problemas com método garante alta disponibilidade, performance consistente, segurança reforçada e um ciclo de melhoria contínua. É um investimento que transforma a infraestrutura em um ativo estratégico, e não apenas em um conjunto de servidores funcionando em segundo plano.

FAQ – Perguntas Frequentes sobre NGINX

Não. O NGINX foi projetado para usar pouca memória, mesmo lidando com milhares de conexões simultâneas. Seu modelo baseado em eventos reduz o consumo e evita processos excessivos.

Sim. Ele atua como intermediário, enviando requisições para qualquer aplicação back-end, incluindo Python, PHP, Java, Node.js, Go e Ruby, sem depender da linguagem usada.

Sim. Com módulos específicos, o NGINX pode entregar vídeos HLS, DASH e transmissões ao vivo com baixa latência, podendo atuar como servidor ou como reempacotador de conteúdo.

Não. Embora ofereça diretivas que ajudam a bloquear acessos maliciosos, ele não substitui um firewall de borda. Ele complementa a segurança, mas não atua como camada primária.

A versão Open Source é gratuita e altamente robusta. A versão Plus inclui recursos extras, como monitoramento avançado, health checks ativos, suporte comercial e módulos adicionais.

Parcialmente. Ele não envia nem recebe e-mails, mas pode atuar como proxy para protocolos como IMAP, POP3 e SMTP, ajudando no roteamento dentro da infraestrutura de e-mail.

Sim. Ele consegue servir arquivos armazenados em sistemas distribuídos, como Ceph, GlusterFS ou S3, mantendo desempenho por meio de cache e otimização de conexões.

Sim. Versões recentes do NGINX já oferecem suporte a HTTP/3 e QUIC, permitindo conexões mais rápidas e eficientes, especialmente em redes móveis ou instáveis.

Sim. Suas diretivas de reescrita e mapeamento permitem transformar URLs, redirecionar caminhos, aplicar lógica condicional e manipular rotas dinâmicas com flexibilidade.

Adequado para ambos. Ele serve desde sites simples com poucas visitas até arquiteturas massivas de alto tráfego, porque é leve, escalável e ajustável conforme o crescimento.